Nicht mehr produktiver. Wertvoller. Der Leadership-Shift im KI-Zeitalter

- Dr. Stefanie Huber

- 19. Dez. 2025

- 6 Min. Lesezeit

Das Harvard-Trust-Dreieck vs. KI: Wo Führungskräfte weiterhin gewinnen

KI verändert nicht nur Workflows. Sie verändert Identität. Und genau deshalb fühlen sich gerade so viele leistungsstarke Führungskräfte merkwürdig … off.

Nicht, weil sie nicht mithalten können.

Nicht, weil sie nicht klug genug wären.

Sondern weil eine Frage im Raum steht, die die meisten Organisationen noch immer nicht beim Namen nennen:

Wenn KI immer mehr von dem kann, wofür ich früher geschätzt wurde … was bin ich dann heute noch wert?

Ich sehe das überall in meinem Coaching. Und ich sehe es in der Arbeit, für die ich gerade angefragt werde.

Die Momente, in denen es offensichtlich wurde

In letzter Zeit bekomme ich von mehreren Seiten Anfragen, Workshops zu konzipieren und zu moderieren – von Konzernen, Beratungen, Agenturen, in Kernfunktionen oder Supportfunktionen – die vor zwei Jahren noch nach Science-Fiction geklungen hätten:

Services und Rollenprofile komplett neu designen

Abbilden, was Menschen künftig „ownen“ sollen

Definieren, was KI übernehmen soll

Und entscheiden, was das Edge einer Rolle ist, sobald KI XYZ übernimmt

Auf dem Papier sieht das nach Strategie aus. In Wirklichkeit ist es Psychologie. Denn in dem Moment, in dem du ein Team fragst: „Was soll KI tun?“, fragst du auch:

„Was wirst du dann noch tun?“

„Wofür wirst du bekannt sein?“

„Was macht dich wertvoll?“

Und hier ist die unbequeme Wahrheit: Die meisten Führungskräfte haben nicht Angst vor KI. Sie haben Angst, ersetzbar zu werden. Veraltet. Nicht mehr gut genug. Ja – und damit füttern wir auch noch unser inneres Imposter-Syndrom. Yay.

Darüber habe ich auf einer Keynote gesprochen – und es ist heute noch relevanter

Mitte des Jahres habe ich in meiner Keynote bei Booking.com einen Blickwinkel geteilt, der immer noch viel zu selten diskutiert wird. Wir reden ständig über den „Edge“ von KI. Aber die eigentliche Führungsfrage ist:

Was ist der Edge von Menschen – nicht von Maschinen?

Denn gerade laufen viele Debatten in Organisationen durch eine einzige, enge Linse:

Kognition.

Wer denkt schneller?

Wer produziert mehr?

Wer fasst besser zusammen?

Wer codet schneller?

Und ja – wenn man Kognition nur als „Speed + Volume“ definierst, verliert der Mensch. Aber das ist nicht das ganze Bild.

Das Harvard Trust Triangle: Warum der „Human Edge“ größer ist als Kognition

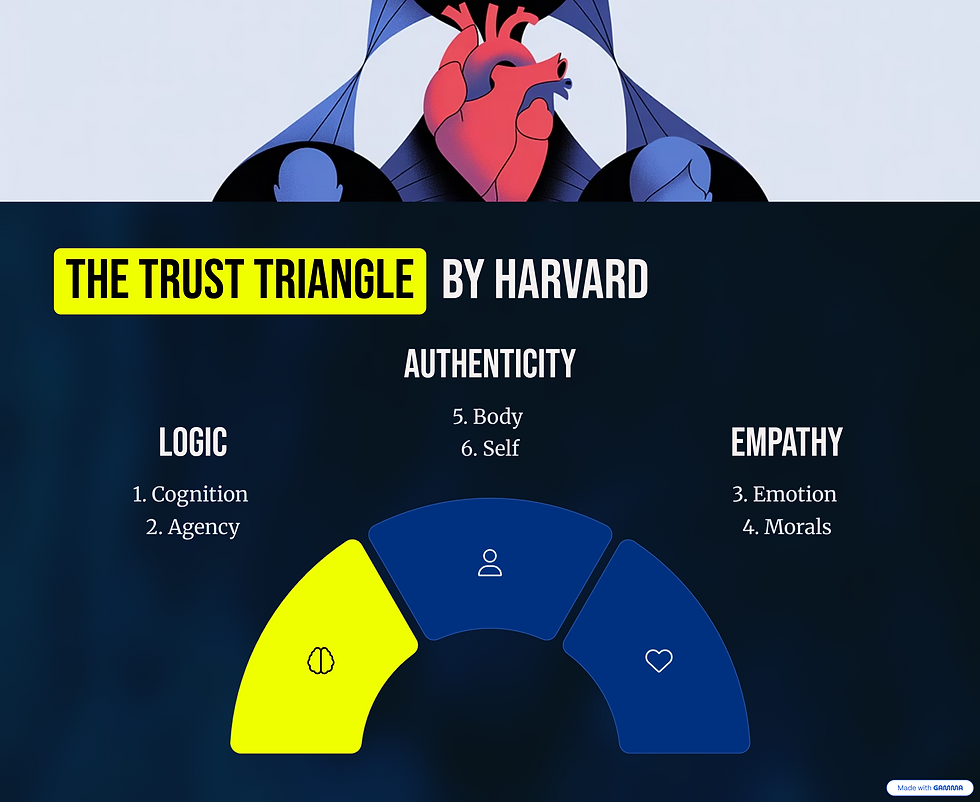

In meinem Booking.com Talk habe ich ein simples Modell genutzt, das ich sehr schätze: das Trust Triangle von Harvard.

Es erinnert uns daran, dass Vertrauen – und Führung – nicht in nur einer Dimension lebt. Und für jede der drei Dimensionen habe ich zwei exemplarische Sub-Dimensionen ergänzt, um tiefer in die aktuelle psychologische Forschung einzutauchen:

Logik (Kognition, Agency/Handlungsfähigkeit)

Empathie (Emotion, Moral)

Authentizität (Körper, Selbst)

Wenn wir die KI-Diskussion auf Kognition reduzieren, reduzieren wir Menschen aus Versehen zu „Prozessoren“. Und genau dann startet diese leise Angst. Denn wenn dein Wert über Processing definiert ist … na ja: Dann fühlst du dich ersetzbar.

Selbst in Kognition haben Menschen noch einen Vorteil

Hier ist die Nuance, die viele übersehen:

KI kann uns in Aufgaben outperformen.

Aber Führung ist so viel mehr als eine Aufgabe, die man „ausführt“.

Selbst im „Logik“-Eck bringen Menschen Fähigkeiten mit, die in heutigen Organisationen entscheidend sind:

Urteilsvermögen unter Ambiguität (wenn Daten unvollständig sind und die Stakes real)

Kontext-Ownership (zu wissen, was hier, jetzt, mit diesen Menschen zählt)

Problem-Framing (zu entscheiden, was die eigentliche Frage ist – nicht nur Antworten zu liefern)

Trade-offs & Accountability (eine Entscheidung treffen und Konsequenzen tragen)

Strategische Priorisierung (Nein sagen, Fokus schützen, Timing setzen)

Wenn du jemals durch eine Reorg, eine Krise oder einen High-Stakes-Launch geführt hast, weißt du: Das Schwierige war nicht „denken“. Das Schwierige war wählen, entscheiden.

Und noch mehr Impact liegt in den zwei anderen Dimensionen

Dort, wo Menschen überproportionalen Wert schaffen – besonders in Zeiten von KI-Transformation – sind die Dimensionen, die wir ständig ignorieren.

Empathie (Emotion + Moral)

Den Raum lesen, wenn Menschen sich nicht sicher fühlen zu sprechen

Das Ungesagte benennen, ohne es zu eskalieren

Ethische Linien halten, wenn „Effizienz“ zur einzigen Kennzahl wird

Entscheidungen treffen, mit denen Menschen leben können – nicht nur Entscheidungen, die auf Slides gut aussehen

Authentizität (Körper + Selbst)

Das unterschätzen Führungskräfte am meisten. Denn dein Nervensystem ist ansteckend.

Menschen spüren deine Regulation, bevor sie deine Strategie hören

Deine Präsenz setzt die emotionale Temperatur im Raum

Deine Integrität (Selbstkongruenz) entscheidet, ob Menschen deinen Worten vertrauen

Deshalb ist der „Human Edge“ kein Motivationsposter. Es ist ein Leadership Operating System.

Der strategische Shift: 4 Linsen, um deine Rolle in einer KI-Welt neu zu designen – als Wertfunktion, nicht als Prozess/Task

Wenn du dich in einer KI-geprägten Organisation wertvoll fühlen (und sein) willst, starte nicht mit:

„Was kann KI?“

Sondern hier:

„Wie verstehe ich meine Rolle – und wo erzeugt mein Human Edge wirklich Wert?“

Die meisten Führungskräfte beschreiben ihren Job noch als Task-Liste. Aber prozessgetriebene Tasks sind genau das, was KI weiter wegrationalisieren wird. Hier sind vier strategische Linsen, um deine Rolle neu zu denken. Nicht als Titel. Sondern als Value Function.

Linse 1: Deine Rolle als Decision Architecture

In komplexen Organisationen ist der Engpass selten Information. Es sind Entscheidungen. Dein Wert ist nicht, dass du „viel weißt“.

Dein Wert ist, dass du dem System hilfst, bessere Entscheidungen zu treffen:

Wer entscheidet was (und wer sollte es nicht)?

Welche Inputs zählen (und welches Noise ignorieren wir)?

Wie schnell müssen Entscheidungen fallen (und wo ist Langsamkeit Weisheit)?

Wie machen wir Trade-offs explizit?

Reflexionsfragen:

Wo stecken Entscheidungen gerade fest – und warum?

Welche Entscheidung wird immer wieder zu mir eskaliert, die ich eigentlich „wegdesignen“ sollte?

Wo verwechseln wir „mehr Daten“ mit „mehr Klarheit“?

Linse 2: Deine Rolle als Meaning-Maker

KI kann Antworten generieren. Aber sie kann deiner Organisation nicht sagen, was diese Antworten bedeuten.

Als Führungskraft stiftest du Bedeutung:

Was zählt dieses Quartal (und was nicht)?

Wofür stehen wir, wenn es unbequem wird?

Wie sieht „gut“ aus, jetzt wo sich die Tools verändert haben?

In welcher Story leben wir gerade?

Reflexionsfragen:

Welche Story erzählt sich mein Team gerade über KI?

Welche Story will ich, dass sie stattdessen lebt?

Wo muss ich den „quiet part“ laut sagen?

Linse 3: Deine Rolle als Trust Infrastructure

Hier wird das Trust Triangle operational. In KI-Transformationen bricht Vertrauen an vorhersehbaren Stellen:

Logik: „Haben wir einen Plan? Ist das kohärent?“

Empathie: „Siehst du, was das mit Menschen macht?“

Authentizität: „Glaubst du wirklich, was du sagst?“

Deine Rolle ist es, Vertrauen über alle drei Dimensionen aufzubauen.

Reflexionsfragen:

Welche Ecke des Dreiecks ist in meiner Führung gerade am schwächsten?

Wo fehlt Vertrauen – in den Plan, in die Fürsorge oder in die Integrität?

Welches Gespräch würde am schnellsten Vertrauen erhöhen – wenn ich den Mut hätte, es zu führen?

Linse 4: Deine Rolle als Human Edge Portfolio

In einer KI-Welt wächst dein Wert, wenn du bewusst in die wenigen menschlichen Fähigkeiten investierst, die sich über andere skalieren.

Denk daran wie an deinen „Superpower Stack“.

Beispiele:

Urteilsvermögen unter Ambiguität

Ethischer Mut

Konfliktnavigation

Taste & strategische Intuition

Präsenz & Nervensystem-Führung

Psychologische Sicherheit aufbauen, ohne Standards zu senken

Reflexionsfragen:

Was sind meine 2–3 menschlichen Superpowers – die Dinge, für die Menschen zu mir kommen?

Wo tauchen sie in meinem Kalender tatsächlich auf?

Was würde ich nicht mehr tun, wenn ich voll darauf vertrauen würde, dass das mein Edge ist?

Was ich dir für diesen Monat vorschlage

Nimm dir 15 Minuten. Kein Laptop. Keine KI. Reflektiere:

Aus welcher der 4 Linsen führe ich aktuell — „default“?

Welche Linse ist unterentwickelt, würde aber 2026 am meisten zählen?

Eine Veränderung, die ich im Januar mache, um in meinen Human Edge zu investieren (Kalender, Gespräche, Entscheidungen).

Wenn diese Reflexionen für dich wertvoll sind: Ich empfehle dir meinen gestrigen LinkedIn-Post, um deine Leadership Learnings für dieses Jahr zu reflektieren: „Forget ChatGPT prompts for the rest of the year.“

Was sonst noch los ist

Das YouTube-Video, das mich diesen Monat am meisten schockiert hat, ist der aktuelle Forschungsstand zu: KI-induzierte Psychosen — bei Menschen, die vorher (!) keine mentalen Probleme hatten. Bitte schau dir das an.

Der wichtigste Artikel, den ich dieses Jahr zusammen mit Elisa Schön geschrieben habe, heißt: „You’re Leaving Millions on the Table: The Economics of Emotion.“ Wenn du ihn noch nicht gelesen hast, ist jetzt vielleicht der Moment — Thomas Lindner, CEO von Innowerft, nannte ihn einen „sharp, illuminating, and inspiring contribution“.

Ich habe einen ausführlichen Blogpost geschrieben über „Zeitmanagement und Selbstorganisation: Strategien für mehr Klarheit und Struktur“, falls dich das interessiert.

Ein weiterer viraler Post: „My biggest failures over the last 6 years“ – viel Spaß.

Komplett off topic, aber für mich genauso wichtig: Ich habe gerade mein Debütalbum veröffentlicht: „The Fragile Order“ – Synth Pop, made in Berlin. Hör rein, wenn du magst.

Wenn dich das anspricht

Wenn du diese leise Frage antreibt – „Bin ich noch wertvoll?“ – du stehst du damit nicht allein da. Und du bist nicht schwach, wenn du dich das fragst. Du bist einfach ein Mensch. Vermutlich ein guter! Wir brauchen dich auf diesem Planeten.

Wenn du nach dem Lesen dieses Artikels mehr Klarheit hast, was dein Edge ist, dann kommentiere gern ein Wort: EDGE.

Und wenn du bereit bist, vom Survival Mode zurück in deine Klarheit und deinen Drive zu kommen, dann melde dich gern bei mir unter stef@stefhuber.com.

— Stef

Kommentare